В алгоритме для оценки здоровья нашли «расовые предрассудки»

Программное обеспечение, которое должно быть беспристрастным, унаследовало вредные человеческие стереотипы.

Ученые из Калифорнийского университета в Беркли совместно с коллегами из Чикаго выяснили, что компьютерные алгоритмы, созданные для исключения предвзятости при оказании медицинской помощи, вместо этого демонстрируют расовые предпочтения. Свою работу авторы опубликовали в Science.

Исследователи проанализировали, как алгоритмы отбирают пациентов для попадания в госпрограмму медицинской поддержки. Предполагается, что это программное обеспечение поможет выделить пациентов с высоким риском здоровью, не руководствуясь человеческими стереотипами, предубеждениями, предрассудками или склонностями. Важно, чтобы нуждающийся в лечении пациент не получал по решению сотрудника отказ из-за «неправильного» пола, расы, образования, религии или образа жизни.

Однако, как показывают работы последнего времени и, в частности, исследование авторов, алгоритмы активно набирают в качестве критериев отбора предубеждения, свойственные людям. Почему так получается? Иногда проблема в подходе к обучению, если речь идет о нейросетях. В случае же, описанном в статье, проблема была в недостатке переменных, которыми оперировала программа.

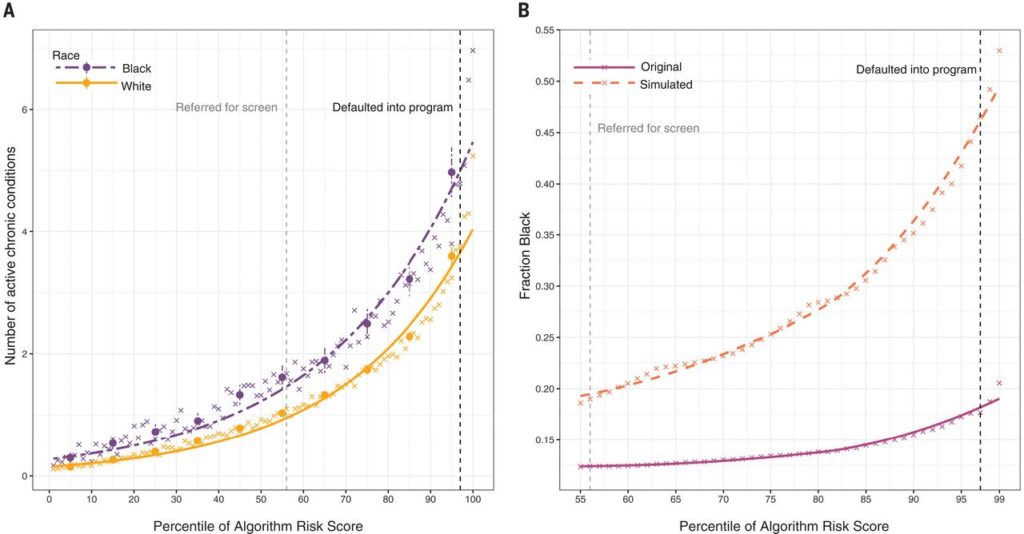

Ученые рассмотрели данные 43 539 белых пациентов и 6079 чернокожих, которых алгоритм должен был либо поместить в группу людей, которым требуется помощь, либо отказать в ней. Задача перед программой стояла такая: выбрать тех пациентов, кому можно помочь с наибольшей эффективностью соотношения «риск — результат — затраты». Выбор, сделанный компьютером, сравнили с объективными показаниями (учитывающими биомаркеры и жизненные показатели), сделанными вручную без учета расы пациента. Оказалось, при отборе программа показала расовую предвзятость, предпочитая здоровых белых американцев и обходя чернокожих пациентов.

Исследователи выяснили, что перекос возник из-за ошибки при построении алгоритма отбора. Чернокожее население при современном состоянии здравоохранения в США хуже обеспечивалось медпомощью и, как следствие, в среднем имеет худшее состояние здоровья. В результате, учитывая сопутствующие заболевания и зачастую большую запущенность основных недугов, раса в алгоритмах программы становится сцепленной с худшими прогнозами и большей стоимостью лечения.

«Сами по себе алгоритмы не являются ни хорошими, ни плохими. Это просто вопрос заботы о том, как они построены. В этом случае проблема в высшей степени решаема, и по крайней мере один производитель [программного обеспечения], кажется, работает над исправлением. Мы призываем других сделать это», — поясняет автор работы профессор Сендхил Малленатан. Внеся в алгоритмы больше переменных — например, учитывающих снижение последующих затрат на лечение за счет небольших расходов на профилактику, — ученые получили нормальное расовое распределение пациентов, прошедших отбор.

По словам исследователей, это показывает, что важно учитывать все факторы при принятии решений, чтобы не получать нежизнеспособные методы оценки. Необходимы регулярные проверки, которые помогут устранять ошибки в вычислениях. «Для алгоритмов, как и для медицины, мы бы предпочли предотвращать проблемы, а не лечить их», — шутит ведущий автор работы Зиад Обермейер.

Исследователи опросили более 60 тысяч испытуемых из разных стран и выяснили: чем больше человек зациклен на себе, тем холоднее он к своему партнеру. Правда, снижение накала страстей не всегда плохо, у этого есть и положительные стороны.

Во время раскопок в римском лагере в Йорке (Англия) нашли стеклянную колбу, поразительно напоминающую древнеегипетские флаконы для кохля — традиционную черную подводку для глаз. Не исключено, что это средство макияжа пользовалось популярностью и у римских солдат.

В популярной литературе сверхмассивные черные дыры чаще всего представляют как разрушители звезд и планет. Авторы новой работы попробовали рассчитать, что на самом деле происходит в окрестностях таких объектов и пришли к противоположному выводу.

Вначале Reuters опубликовал статью о взаимоотношениях SpaceX и Пентагона, которую миллиардер --- традиционно для его отношений с этим изданием — назвал фейком. Опровергая ее тезисы, он обнародовал информацию, не представленную ранее публично.

Исследователи опросили более 60 тысяч испытуемых из разных стран и выяснили: чем больше человек зациклен на себе, тем холоднее он к своему партнеру. Правда, снижение накала страстей не всегда плохо, у этого есть и положительные стороны.

Провинция Цзянсу была процветающим центром медицинской практики в Китае во времена династии Мин (1368-1644 годы нашей эры). Микроскопический анализ крошечных частиц на поверхности хирургических ножниц и пинцета из гробницы китайского врача помог выявить следы вещества, получаемого из ядовитого растения, которое, по мнению исследователей, применялось как местная анестезия во время операций.

В высокогорных районах Гималаев появился новый хищник. Он не боится людей, возглавляет стаи собак и все чаще заходит в деревни. Местные жители называют его «кхипшанг». Речь идет о гибриде гималайского волка и бродячей собаки. Ученые опасаются, что этот зверь изменит хрупкий баланс местной дикой природы и в скором времени станет весьма опасным для человека.

В доколумбовых Андах принадлежность к правящему роду определяла доступ к земле, торговле и статусу, поэтому удержать все внутри семьи было вопросом выживания. Ученые выяснили, что элиты долины Чинча решали эту задачу самым прямым способом — заключая браки между родственниками на протяжении как минимум двух поколений.

При совпадении нескольких условий наши глаза способны улавливать излучение в ближнем инфракрасном спектре. Тогда сетчатка начинает работать как нелинейный фотодетектор.

Вы попытались написать запрещенную фразу или вас забанили за частые нарушения.

Понятно

Что-то в вашем комментарии показалось подозрительным, поэтому перед публикацией он пройдет модерацию.

Понятно

Из-за нарушений правил сайта на ваш аккаунт были наложены ограничения. Если это ошибка, напишите нам.

Понятно

Наши фильтры обнаружили в ваших действиях признаки накрутки. Отдохните немного и вернитесь к нам позже.

Понятно

Мы скоро изучим заявку и свяжемся с Вами по указанной почте в случае положительного исхода. Спасибо за интерес к проекту.

Понятно

Последние комментарии