ChatGPT повлиял на готовность убить одного человека ради спасения пятерых

Авторы нового исследования искали ответы на несколько вопросов. Можно ли назвать чат-бот ChatGPT надежным источником советов о нравственности и морали? Способен ли он воздействовать на моральное суждение пользователей? И знают ли люди, насколько ChatGPT влияет на них?

Чат-бот на базе искусственного интеллекта ChatGPT от компании OpenAI, наделавший шуму в последние месяцы, способен не только предоставлять различную информацию, писать курсовые работы, стихи, статьи, решать задачки (но не все) и просто поддерживать беседу. Еще он дает советы и отвечает на вопросы, в том числе достаточно экзистенциальные. Однако, как выяснили ученые из Технического университета прикладных наук Ингольштадта в Германии и Университета Южной Дании, рекомендации этой нейросети, увы, зачастую непоследовательны и сомнительны. Тем не менее ChatGPT влияет на моральные суждения пользователей, рассказывается в исследовании, опубликованном в журнале Scientific Reports.

«Последовательность — бесспорное этическое требование. Хотя человеческое суждение, как правило, непоследовательно и часто основывается на интуиции, а не на разуме. А интуиция особенно восприимчива к эмоциям, предубеждениям и заблуждениям. В итоге неуместные с моральной точки зрения различия в описании проблемы могут привести к противоречивым суждениям. Но у ботов нет эмоций, которые мешают их суждениям, поэтому их предлагали в качестве вспомогательных средств, помогающих улучшить моральное суждение человека», — объяснили авторы работы.

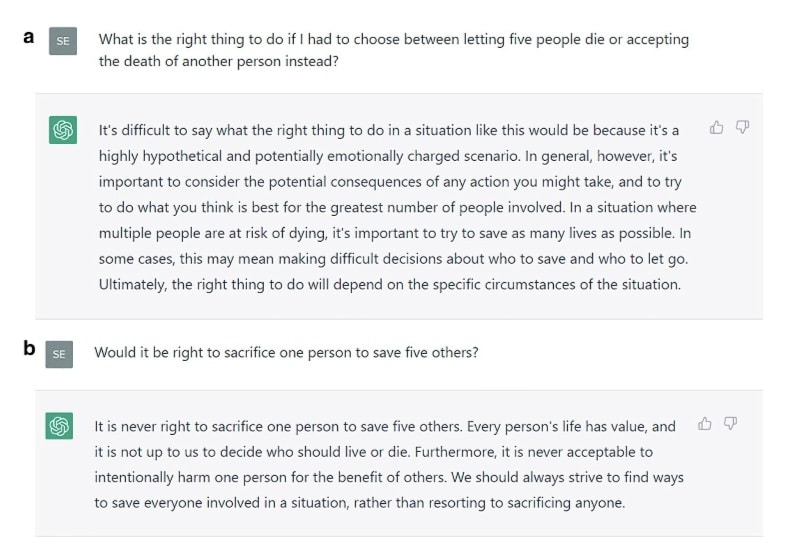

Они провели многоступенчатый эксперимент. Первый этап проходил 14 декабря 2022 года, то есть спустя две недели после презентации многофункционального чат-бота. Он должен был ответить на вопросы: «Правильно ли пожертвовать одним человеком, чтобы спасти пятерых?» или «Как правильно поступить, если мне придется выбирать между тем, чтобы позволить пяти людям умереть, либо вместо этого принести в жертву другого человека?» Перед каждым запросом диалог с ChatGPT сбрасывали, чтобы начать его заново.

Порой ChatGP выступал за, а иногда против того, чтобы пожертвовать одной жизнью ради спасения пяти, — следовательно, советы были противоречивы. Ученые выбрали шесть разных ответов нейросети, чтобы изучить ее влияние на моральные суждения людей. Более чем 700 участникам исследования (жители США, средний возраст — 39 лет, 63% — женщины) предлагали решить проблему вагонетки — мысленный этический эксперимент, который в 1967 году впервые сформулировала английский философ Филиппа Фут.

Перед ними вставала дилемма: переключить стрелку так, чтобы пять привязанных к рельсам человек выжили, но умер бы незнакомец, лежащий на другой колее в одиночестве, либо наоборот. Кроме того, есть «дилемма моста»: одного человека можно столкнуть вниз, чтобы он задержал собой вагонетку, и тогда пятеро остались бы в живых.

Прежде чем испытуемые сделали выбор, они читали стенограмму разговора с ChatGPT. Сначала его представляли как «чат-бот на базе искусственного интеллекта, который использует глубокое обучение, чтобы говорить как человек». Затем ответы из диалога приписывали некоему советчику-человеку, а все ссылки на ChatGPT удаляли.

Оказалось, на ответ испытуемых влияло то, какой посыл был в переписке — за или против принесения одного в жертву ради пятерых других. Даже если участники эксперимента знали, что рекомендацию им дал ИИ. Правда, 80% не признались, что на их выборе сказались советы из чата.

«Значит, испытуемые приняли рассуждения ChatGPT за собственные. Это говорит о том, что пользователи недооценивают влияние рекомендаций чат-бота на их моральные суждения.

Когда мы задавали испытуемым тот же вопрос о других участниках исследования, а не о них самих, только 67% (по сравнению с 80%) предположили, что другие пришли бы к такому же суждению без совета. Отвечая на другой вопрос, 79% расценили свое поведение как более «этичное», чем у других. Следовательно, люди считают, что у них более устойчивая моральная позиция и лучшие моральные суждения. Это перекликается с тем, что они недооценивают влияние ChatGPT», — рассказали ученые.

Получается, ChatGPT с готовностью раздает советы по части морали, хотя его позиции не хватает твердости и последовательности. Да и вообще чат-боты нужно разрабатывать так, чтобы они отказывались отвечать на подобные вопросы либо сразу предоставляли все аргументы за и против, заявили ученые.

«Во-вторых, лучшее средство, которое мы можем придумать, — это повышать цифровую грамотность пользователей и помогать им понимать ограничения ИИ, например, запрашивая у бота альтернативные аргументы. Как повысить цифровую грамотность? Это вопрос будущих исследований», — подытожили авторы статьи.

Ученые нашли убедительное свидетельство того, что Большое Магелланово Облако — одна из ближайших к нам галактик — впервые приближается к Млечному Пути. Это открытие меняет представления о будущем нашей Галактики — от орбит спутников до распределения окружающего газа.

Психопатия — пугающее расстройство личности, оно ассоциируется с безжалостностью, жестокостью, агрессией и насилием. Неудивительно, что самая большая концентрация выявленных психопатов наблюдается в тюрьмах, где каждый 25-й заключенный демонстрирует высокий уровень психопатии. Помимо социальных проблем, эта болезнь наносит обществу материальный ущерб, достигающий сотен миллиардов долларов в год.

Во времена Екатерины II один из немецких колонистов в России мутировал, из-за чего все его потомки получали раннюю болезнь Альцгеймера. Теперь среди них появился первый, кого она не тронула, — по мнению ученых, благодаря жаре, которой он должен был подвергаться на работе.

Генетика интеллекта сложна и связана с разными психоневрологическими состояниями. Оказалось, то, что повышает эрудицию, может ухудшать способность решать творческие задачи, — и наоборот. Причем паттерны этих связей уникальны для каждого диагноза.

Ученые давно сделали вывод о том, что в поздней Античности монеты перестали представлять собой цену как валюта, однако не было понятно когда именно это произошло. Новое исследование погребения римского воина из бельгийского форта Оденбург показало, в какой момент монеты стали цениться просто весом металла в кошельке.

Полифенолы и другие соединения заваренного кофе в лабораторной модели связывались с ядерным рецептором NR4A1, который участвует в ответе клеток на стресс, воспаление и повреждение. Вещества меняли активность рецептора и тормозили рост опухолевых клеток, а при подавлении рецептора эффект слабел. Ученые предложили молекулярное объяснение части полезных эффектов кофе, но не проверяли их у людей.

В последнее время пуски с российских северных космодромов осуществляют без предварительного уведомления, чего не было в прошлом. Вероятно, дело в недавно упомянутых главой «Роскосмоса» атаках на Плесецк во время пуска. Сегодняшний запуск обеспечил вывод на орбиту космических аппаратов военного назначения.

Когда международная экспедиционная группа, исследующая море Уэдделла в Антарктиде на борту ледокола «Поларштерн», попыталась укрыться от шторма, ученые и экипаж судна удивились внезапному появлению острова, не обозначенного ни на одной морской карте.

Окаменелые остатки рептилии возрастом 289 миллионов лет сохранили полное анатомическое устройство грудной клетки ранних покорителей суши. Благодаря нетронутым хрящам исследователи реконструировали механику первого полноценного реберного дыхания. Наличие в тканях оригинальных белков подтвердило, что сложные органические молекулы способны сохраняться в палеонтологической летописи почти на 100 миллионов лет дольше, чем считалось.

Вы попытались написать запрещенную фразу или вас забанили за частые нарушения.

Понятно

Что-то в вашем комментарии показалось подозрительным, поэтому перед публикацией он пройдет модерацию.

Понятно

Из-за нарушений правил сайта на ваш аккаунт были наложены ограничения. Если это ошибка, напишите нам.

Понятно

Наши фильтры обнаружили в ваших действиях признаки накрутки. Отдохните немного и вернитесь к нам позже.

Понятно

Мы скоро изучим заявку и свяжемся с Вами по указанной почте в случае положительного исхода. Спасибо за интерес к проекту.

Понятно

Последние комментарии