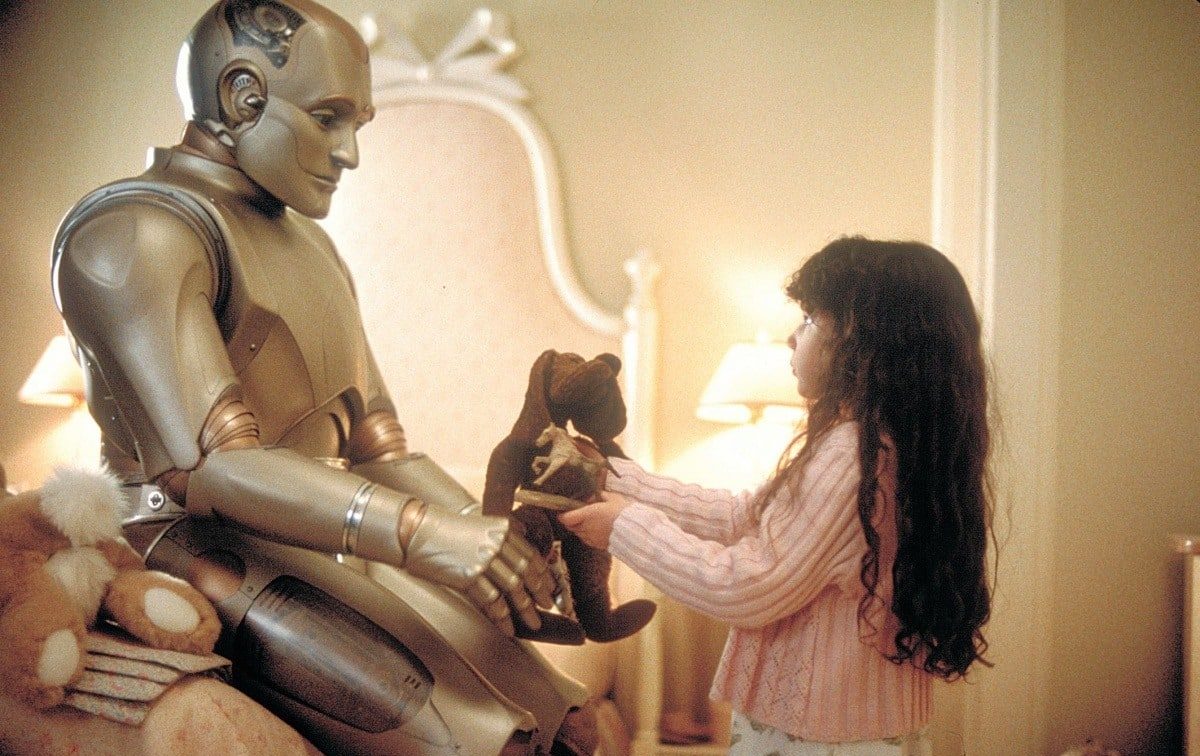

«Яндекс» начал крупномасштабный эксперимент по поиску возможного сознания у искусственного интеллекта

Может ли у искусственного интеллекта проявиться сознание? Этот вопрос интересует ученых и инженеров по всему миру. Российская компания «Яндекс» решила провести исследование, которое поможет ответить на него.

«Яндекс» запустил эксперимент, который в перспективе может ответить на вопрос: «Есть ли сознание у искусственного интеллекта?»

Исследователи пояснили, что человека отличает способность к рефлексии — это оказывает на него влияние, меняет его понимание тех или иных вещей и событий. Обычная модель искусственного интеллекта, напротив, каждый раз генерирует ответ «с чистого листа». Авторы проекта захотели понять, получится ли у модели формировать внутренние убеждения на основе собственных рассуждений, как это делает человек.

Исследователи хотят подтвердить или опровергнуть основную гипотезу: если модель будет глубоко рефлексировать над каждым вопросом, а следом обучаться на собственных размышлениях, у нее могут появиться внутренние предпочтения. В этом случае модель начнет давать более последовательные ответы и отстаивать свою точку зрения. Поскольку проект — научный поиск, то гипотезы и методология могут измениться в процессе работы.

«Есть надежда, что если мы начнем обучать нейронную сеть на ее собственных рассуждениях, то получится сделать модель, у которой появится действительно своя точка зрения. Не „навязанная“ и не ее имитация, а внутренние убеждения», — рассказал автор проекта, директор по развитию технологий искусственного интеллекта «Яндекса» Александр Крайнов.

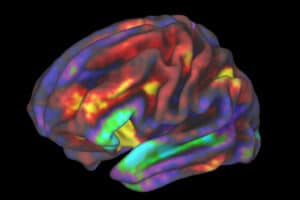

Одна из целей исследования — возможность глубже понять природу человеческого мышления. Исследователи сейчас не могут экспериментировать с человеческим сознанием, а здесь у них появится «песочница» для изучения разума.

«Ведь у нас никогда еще не было пусть примитивной и не полной, но работающей модели человеческого разума», — пояснил Крайнов.

Он подчеркнул, что такие эксперименты полезны и для нейробиологов. Крайнов добавил, что в качестве научного консультанта в проекте участвовал нейробиолог, доктор медицинских наук, профессор, академик РАН Константин Анохин.

Со стороны «Яндекса» к эксперименту присоединились исследователи Лаборатории искусственного интеллекта «Яндекса», а также студенты и преподаватели Школы анализа данных (ШАД). Команда приступила к первым экспериментам в конце лета. На начальном этапе участники проверили способность базовой модели формировать стабильные предпочтения без дополнительного обучения. Они убедились, что такой способности у модели нет.

В ближайшее время исследователи приступят к основному этапу эксперимента. Команда будет побуждать модель к рассуждению и рефлексии, мотивировать обучаться на собственных размышлениях.

«Очень увлекательно и интригующе наблюдать, как в самых разных областях, связанных с искусственным интеллектом, например в обучении роботов, данные не просто накапливаются на будущее, а непосредственно малыми порциями влияют на поведение», — рассказал Алексей Толстиков, руководитель Школы анализа данных «Яндекса».

В рамках научного поиска исследователи тестируют разные открытые модели, в том числе открытые модели «Яндекса». Авторы сфокусировались именно на опенсорсных решениях, чтобы обеспечить прозрачность и воспроизводимость эксперимента.

Некоторые из моделей обладают навыком рассуждения — это так называемые reasoning модели. Одну из гипотез ученые сформулировали конкретно для них. Они предположили, что в процессе логических размышлений такие модели смогут самостоятельно приходить к определенным выводам. Участники проекта не создают никаких ограничений или рамок. Напротив, базовая языковая модель сохраняет естественную способность рассуждений.

«Изучение мышления, логики, процесса накопления знаний и создания новых идей — очень захватывающая область, так как может позволить открыть новые возможности и в области искусственного интеллекта, и в области понимания человека», — отметил Толстиков.

Авторы эксперимента ожидают получить первые результаты, позволяющие подтвердить или опровергнуть основную гипотезу, до конца года.

Китайский аппарат Tianwen-1, находясь на орбите Марса, снял 3I/ATLAS с редкого ракурса вне плоскости орбиты межзвездной кометы. Наблюдение и моделирование показали, что кому кометы заполняют крупные частицы размером в сотни микрометров, выбрасываемые с массовым расходом примерно тонна в секунду.

Новое исследование, проведенное на большой выборке взрослых жителей США, показало, что чем больше в рационе питания продуктов с высоким содержанием фолатов, магния, селена и клетчатки, тем ниже риск депрессии, и наоборот.

Астрофизики Южного федерального университета предложили объяснение одной из самых интригующих загадок современной физики — годичных колебаний сигнала в детекторе DAMA/LIBRA, который вот уже почти тридцать лет регистрирует странные сигналы в подземной лаборатории Гран-Сассо в Италии, интерпретируемые как взаимодействие частиц темной материи с обычным веществом.

В высокогорных районах Гималаев появился новый хищник. Он не боится людей, возглавляет стаи собак и все чаще заходит в деревни. Местные жители называют его «кхипшанг». Речь идет о гибриде гималайского волка и бродячей собаки. Ученые опасаются, что этот зверь изменит хрупкий баланс местной дикой природы и в скором времени станет весьма опасным для человека.

При совпадении нескольких условий наши глаза способны улавливать излучение в ближнем инфракрасном спектре. Тогда сетчатка начинает работать как нелинейный фотодетектор.

Во всем мире во всех человеческих культурах около 90% людей пользуются преимущественно правой рукой. Такое поразительное единство практически всего человечества не имеет аналогов среди приматов и до сих пор остается эволюционной загадкой. Ученые проанализировали данные о более чем двух тысячах человекообразных обезьянах и выяснили, когда и почему праворукость стала популяционной тенденцией.

В последнее время пуски с российских северных космодромов осуществляют без предварительного уведомления, чего не было в прошлом. Вероятно, дело в недавно упомянутых главой «Роскосмоса» атаках на Плесецк во время пуска. Сегодняшний запуск обеспечил вывод на орбиту космических аппаратов военного назначения.

В высокогорных районах Гималаев появился новый хищник. Он не боится людей, возглавляет стаи собак и все чаще заходит в деревни. Местные жители называют его «кхипшанг». Речь идет о гибриде гималайского волка и бродячей собаки. Ученые опасаются, что этот зверь изменит хрупкий баланс местной дикой природы и в скором времени станет весьма опасным для человека.

Астроциты — клетки, которые долго считались лишь «помощниками» нейронов — оказались частью скрытой системы связи в мозге. Они, как показали результаты нового исследования, формируют собственные протяженные сети, соединяющие разные части головного мозга. Это открытие меняет представление о том, как мозг координирует свою работу, адаптируется к новым условиям и восстанавливается после повреждений.

Вы попытались написать запрещенную фразу или вас забанили за частые нарушения.

Понятно

Что-то в вашем комментарии показалось подозрительным, поэтому перед публикацией он пройдет модерацию.

Понятно

Из-за нарушений правил сайта на ваш аккаунт были наложены ограничения. Если это ошибка, напишите нам.

Понятно

Наши фильтры обнаружили в ваших действиях признаки накрутки. Отдохните немного и вернитесь к нам позже.

Понятно

Мы скоро изучим заявку и свяжемся с Вами по указанной почте в случае положительного исхода. Спасибо за интерес к проекту.

Понятно

Последние комментарии