Уведомления

Авторизуйтесь или зарегистрируйтесь, чтобы оценивать материалы, создавать записи и писать комментарии.

Авторизуясь, вы соглашаетесь с правилами пользования сайтом и даете согласие на обработку персональных данных.

Исследователи из OpenAI показали неустранимость галлюцинаций нейросетей

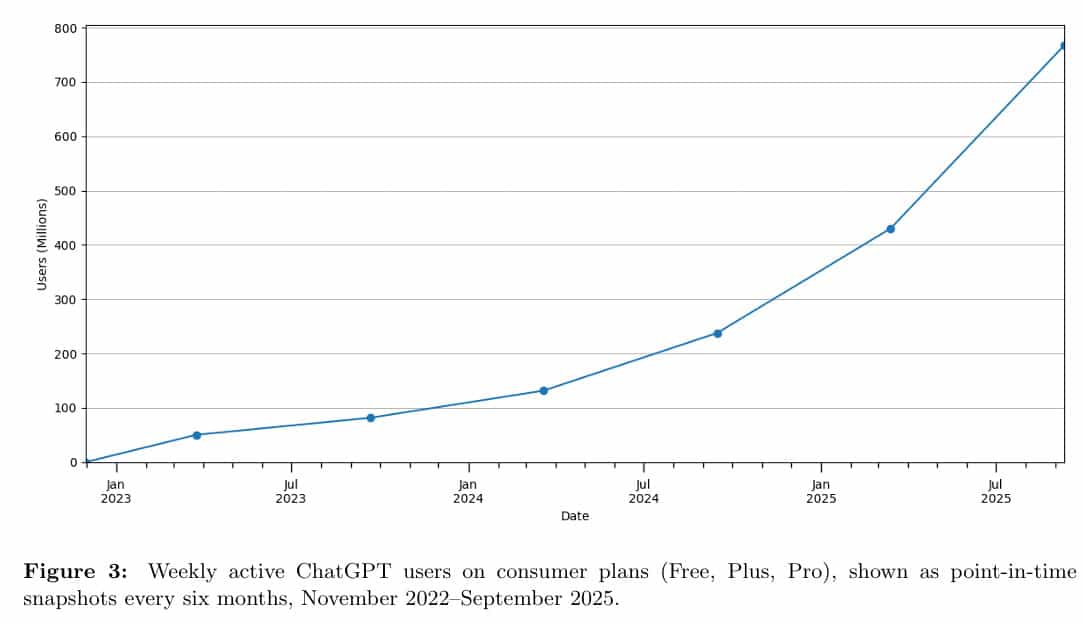

Периодически нейросети в своих ответах галлюцинируют, предлагая пользующимися их услугами людям выпить яд под видом лекарства и так далее. Новая научная работа показала, что эта проблема связана с самой природой нейросети. Хотя ее вероятность можно понизить, устранить полностью невозможно.

От способности нейросетей работать надежно зависит не просто чат обычных пользователей с ними, но и выживание ряда людей. Кто-то погибает из-за некорректных советов больших языковых моделей типа ChatGPT, кто-то может умереть из-за галлюцинации нейросети, управляющей автопилотом — тот, например, может принять обочину за дорогу и в итоге увести машину прямо в дерево (речь идет о гипотетическом случае). Учитывая, что такой автопилот стоит как подержанное авто, ясно, что подобные записи существенно снижают привлекательность автопилота для разумных потребителей.

Авторы новой работы, которую они выложили на сервер препринтов Корнеллского университета, решили выяснить, возможно ли в принципе решить проблему подобных галлюцинаций и сколько это будет стоить. Оказалось, что причины возникновения галлюцинаций разнообразны и полное их подавление поэтому нереалистично.

Во-первых, ошибки неизбежно содержатся в обучающей выборке текстов (или, в случае нейросетей для вождения, видеозаписей того, как водят реальные люди). Выборка может быть свободной от ошибок, только если она очень мала, а на такой нельзя построить работоспособную нейросеть в принципе.

Во-вторых, даже существуй некая большая выборка с нулевым количеством ошибок, это не решило бы проблему. В случае языковых моделей сам метод генерации их выдачи провоцирует галлюцинации. Они «предсказывают» каждое следующее слово в предложении, основываясь на вероятностях. В предложениях много слов, а вероятность ошибок нарастает с каждым последующим.

Вдобавок добавление каждого слова дает определенные оттенки смысла, а с ними растет и вероятность ошибки. Если бы нейросети задавали вопросы, требуя лишь ответа «да»/»нет«, вероятность неверного ответа была, как показали исследователи, как минимум вдвое ниже. Именно бинарная классификация удается им лучше всего.

В-третьих, крайне трудно устранимым источником галлюцинаций оказались системы тестирования нейросетей. Любая из них может достигнуть нулевой частоты галлюцинаций, если ее жестко «наказывать» за неправильные ответы, снижая баллы. Чтобы повысить их, нейросеть быстро начнет писать «Я не знаю» в ответ на любой вопрос, который не содержался в ее обучающей выборке. Но в таком случае она будет отвечать «Я не знаю» в очень большом числе случаев (десятки процентов). С точки зрения стандартного потребителя переход от нейросети, уверенно рассуждающей на нужную ему тему, к той, что в каждом четвертом случае станет генерировать «Я не знаю», будет снижением качества продукта.

Естественно, создатели языковых моделей стараются избежать такого, и их системы оценки выдачи нейросети «штрафуют» ее низкими баллами за частые ответы «Я не знаю». Это и становится третьим источником галлюцинаций: нейросети выгоднее сказать что угодно, потому что она может или угадать случайно, или оценивающие ее люди либо программы не смогут понять ее ошибку. Такое поведение часто демонстрируют студенты, пытающиеся прорваться через экзамен по сложному предмету «на шару».

Исследователи предположили, что можно частично обойти эту проблему — скажем, побуждая языковую модель задавать уточняющие вопросы в тех случаях, когда она не уверена в ответе. Метод рабочий, но чрезвычайно быстро повышающий вычислительные усилия, нужные на один ответ. Такое может быть оправдано в сложных отраслях с высокой ценой ошибки, но в условно-бесплатном чат-боте окупить его будет непросто.

Все это означает, что на практике нейросети без галлюцинаций предельно маловероятны и в будущем. Соответственно, нужно строить их использование с учетом практической неустранимости галлюцинаций, не полагаться на их ответы в тех случаях, когда цена ошибки может быть слишком высока. Это ставит под вопрос эффективность нейросетей и в области автопилота. Но окончательно разрешить сомнения по этому поводу может только практика ближайших лет.

Обломки, найденные на дне Кадисского залива, оказались потопленным Фрэнсисом Дрейком торговым судном

Ученые смогли установить, что обломки затонувшего корабля, обнаруженные на морском дне возле испанского города Кадис, принадлежали генуэзскому торговому судну. Его потопили в 1587 году, во время налета на город английской эскадры под командованием Фрэнсиса Дрейка.

Ученые, похоже, приблизились к разгадке происхождения пшеницы мягкой — той самой, из которой делают большую часть хлеба и другие мучные изделия. Согласно авторам нового исследования, она, предположительно, появилась 8000 лет назад на территории современной Грузии и Армении.

Клешни и жало скорпионов имеют участки, усиленные металлами. Авторы нового исследования выяснили, что в этих структурах содержатся строго определенные элементы — это напрямую связано с тем, как разные виды охотятся и защищаются.

В последнее время пуски с российских северных космодромов осуществляют без предварительного уведомления, чего не было в прошлом. Вероятно, дело в недавно упомянутых главой «Роскосмоса» атаках на Плесецк во время пуска. Сегодняшний запуск обеспечил вывод на орбиту космических аппаратов военного назначения.

Палеонтологи описали новый вид хищного клопа из мелового периода, передние лапы которого эволюционировали в клешни-пинцеты. Подобная анатомическая трансформация стала лишь четвертым задокументированным случаем за всю историю насекомых. Ископаемый вид получил название в честь корейской поп-группы Stray Kids из-за характерного положения застывших в смоле конечностей.

Релиз довольно неожиданно перенес время образования протонов и нейтронов в более раннее прошлое Вселенной. К сожалению, из его текста осталось неясным научное обоснование таких фундаментальных изменений в космологии. Также он резко передвинул в прошлое и момент возникновения реликтового излучения.

В последнее время пуски с российских северных космодромов осуществляют без предварительного уведомления, чего не было в прошлом. Вероятно, дело в недавно упомянутых главой «Роскосмоса» атаках на Плесецк во время пуска. Сегодняшний запуск обеспечил вывод на орбиту космических аппаратов военного назначения.

Четыре человека, летящие к Луне, столкнулись с целым рядом мелких неприятностей — от низкой температуры в начале работы до поломки мочевыводящей системы туалета на вторые сутки и необходимости взамен пользоваться пакетами. К счастью, пока самые крупные сложности удалось компенсировать. Но все они вместе могут сдвинуть ситуацию к решению, о котором Naked Science уже говорил в нашем видеоподкасте о миссии: не исключено, что при высадке астронавтов на Луне их корабль состыкуют со Starship не на окололунной, а уже на околоземной орбите.

Когда международная экспедиционная группа, исследующая море Уэдделла в Антарктиде на борту ледокола «Поларштерн», попыталась укрыться от шторма, ученые и экипаж судна удивились внезапному появлению острова, не обозначенного ни на одной морской карте.

Вы попытались написать запрещенную фразу или вас забанили за частые нарушения.

Понятно

Что-то в вашем комментарии показалось подозрительным, поэтому перед публикацией он пройдет модерацию.

Понятно

Из-за нарушений правил сайта на ваш аккаунт были наложены ограничения. Если это ошибка, напишите нам.

Понятно

Наши фильтры обнаружили в ваших действиях признаки накрутки. Отдохните немного и вернитесь к нам позже.

Понятно

Мы скоро изучим заявку и свяжемся с Вами по указанной почте в случае положительного исхода. Спасибо за интерес к проекту.

Понятно

Последние комментарии