Исследование опубликовано в Programming and Computer Software. Современные системы распознавания образов трудно представить без нейронных сетей. Эти технологии нашли широкое применение в мобильных и специализированных устройствах. На протяжении последних десятилетий исследователи искали способы улучшения производительности нейронных сетей, разрабатывая различные подходы, такие как квантование нейронных сетей и удаление весов. Одним из наиболее перспективных направлений стало создание упрощенных моделей нейронов, которые используют менее сложные операции по сравнению с классическими моделями.

Биполярный морфологический нейрон — это модель, которая использует операции сложения и взятия максимума вместо умножения и сложения, характерных для классических нейронов. Эта модель потенциально более энергоэффективна, так как операции сложения требуют меньше вычислительных ресурсов, чем операции умножения. Однако, несмотря на свои преимущества, биполярные морфологические нейроны требуют четыре ветви вычислений для достижения удовлетворительного качества распознавания, а также сталкиваются с трудностями при обучении.

Принцип работы послойной дистилляции знания для БМ моделей для двух последовательно добавляемых слоев: а) для первого слоя, б) для второго слоя / © Programming and Computer Software

В новой работе ученые из МФТИ и Smart Engines с коллегами представили полутораветочную модель биполярного морфологического нейрона, которая сокращает количество вычислительных веток с четырех до одной. Кроме того, они разработали для этой модели новый метод обучения, который позволяет достичь точности, сопоставимой с классическими моделями. Основной целью исследования было улучшение структуры нейрона, что, в свою очередь, должно было повысить его вычислительную эффективность.

В процессе исследования использовался метод дистилляции знаний, который позволяет передавать информацию от учительской сети к ученической. Этот метод включает в себя изменение функции потерь, учитывающей выходы как ученической, так и учительской сетей. Результаты показали, что для LeNet-подобных сверточных моделей на выборке MNIST точность классификации составила 99,45 процента, а на выборке CIFAR10 — 86,69 процента. Эти показатели не уступают результатам классических нейронных сетей, что подтверждает эффективность предложенного подхода.

Во время обучения ученическая сеть строится последовательно слой за слоем. Для каждого добавляемого слоя к функции потерь добавляется среднеквадратичная ошибка между ним и классическим слоем учительской сети (CNN), после этого выход добавленного слоя передается в следующий слой учительской сети. На следующем шаге только что обученный слой фиксируется и выполняется обучение следующего слоя. В итоге к концу обучения будет обучена вся ученическая сеть.

Однако классический метод обратного распространения ошибки работает медленно с биполярными морфологическими нейронами из-за операции поиска максимума. Эта операция заставляет алгоритм обновлять лишь один вес на каждой итерации. Чтобы ускорить обучение, авторы исследования использовали непрерывную аппроксимацию для операции максимума, которая позволяет алгоритму сходиться быстрее благодаря обновлению большего количества весов за один шаг.

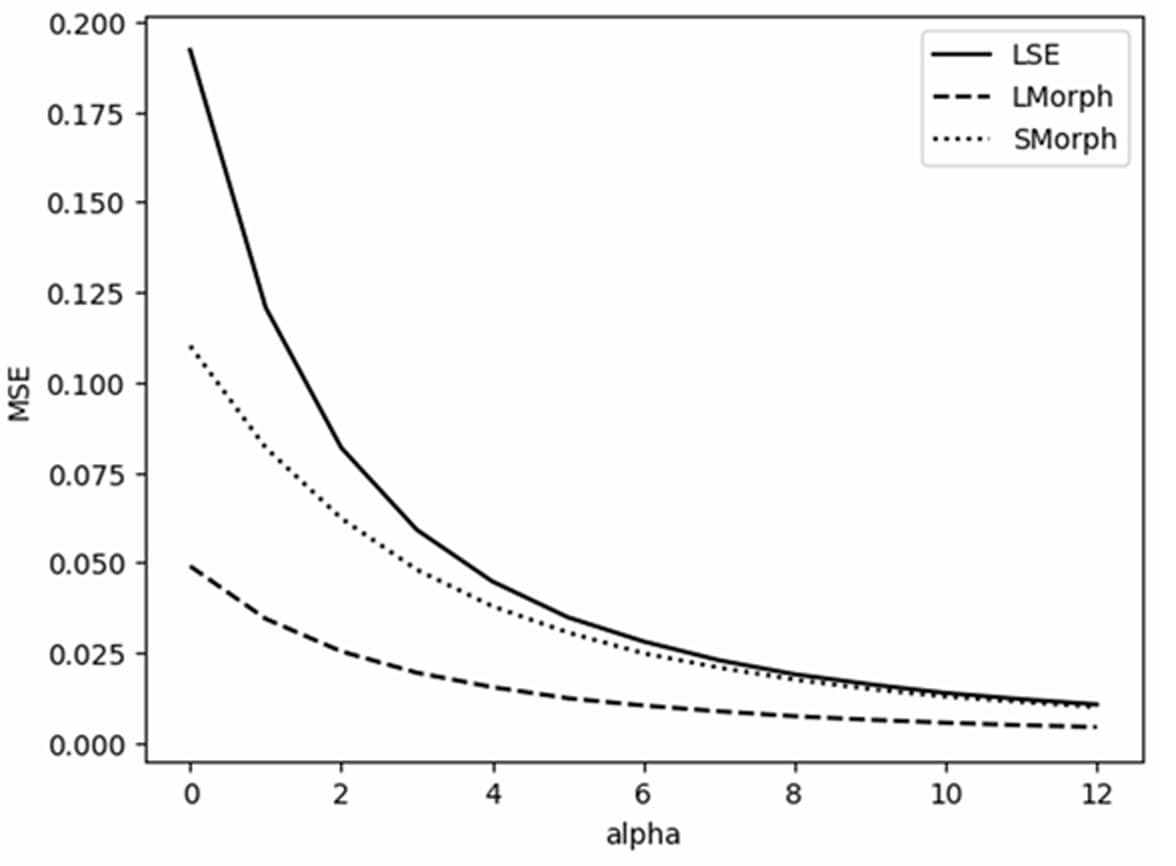

В исследовании были проанализированы результаты работы алгоритма обучения нейронной сети, использующие три разных формулы аппроксимации максимума, причем каждая из этих формул зависела от одного вещественного параметра.

Все три аппроксимации при значении параметра α больше 20 практически неотличимы от настоящего максимума. При использовании этих аппроксимаций при не слишком больших значениях параметра ɑ в нейронах на каждом шаге обратного распространения ошибки будет обновляться большее число весов, чем при использовании точного максимума, и это значительно улучшает обучаемость сети.

Для обучения моделей с помощью описанных методов дистилляции знаний использовались непрерывные аппроксимации максимума в два этапа. Первый этап — это обучение модели с аппроксимацией с помощью дистилляции знаний. Поскольку в предложенных аппроксимациях есть операции умножения и деления, то нужен еще один этап, в котором аппроксимация заменяется на точный максимум с сохранением полученных ранее весов. Далее получившаяся сеть дообучается с помощью дистилляции знаний.

«Мы исследовали новый способ построения нейронной сети, продемонстрировав, что наш метод обучения позволяет достигать высоких результатов с упрощенной структурой нейронов. Это открывает путь к созданию более энергоэффективных и быстрых нейронных сетей», — отметил Михаил Зингеренко, аспирант МФТИ.

Работа открывает новые возможности для развития технологий, основанных на биполярных морфологических нейронных сетях. Они представляют интерес в тех областях, где необходимо использование специализированных распознающих устройств, отличающихся аппаратной и энергетической эффективностью, таких как медицинская диагностика, автономные системы и многие другие.

Следующие шаги в этой области включают дальнейшие эксперименты и дополнительные компьютерные симуляции, которые могут привести к новым открытиям и улучшениям в области биполярных морфологических нейронных сетей и их применения в реальных задачах. Ученые планируют исследовать влияние различных архитектур таких сетей на эффективность и точность классификации, а также возможности интеграции новых методов обучения в существующие системы.

Таким образом, исследование российских ученых является важным вкладом в развитие нейронных сетей и их применения.